岡山大学の研究グループは,九州工業大学,東京大学の協力を得て,自律型水中ロボットAUV(Autonomous Underwater Vehicle)の水中嵌合実験に成功した(ニュースリリース)。

深海用水中ロボットには,水中汚染物(放射能汚染物等含む)の発見・回収,深海底地形調査・資源回収,機雷撤去,水産資源育成・捕獲,海難事故対応等さまざまなニーズがある。しかしながら,水中ロボットは地上で動作するロボットとは異なり,①水中では無線による通信が不可能,②ロボット技術者が近くで状況を確認することは難しい,③浮遊航行体の運動制御であるためAUVが振動しやすい,④海底での作業は底泥巻き上げによる視界不良が発生しやすいなど,地上ロボットに比べて困難な点が多く。このような状況は惑星探査衛星や探査ロボットと共通している点が多い。

一方,地上のロボット制御技術においては,主に視覚情報を用いたビジュアルサーボ技術により作業用ロボットの自動作業の実用化が進んでいるが,①対象物の3次元空間認識が困難,②動画像処理の研究はあまり進んでいない,③未知環境下での自律的な動作が可能なロボット(このようなロボットを知能ロボットと呼ぶ)の実用化は進んでいないなどの課題がある。

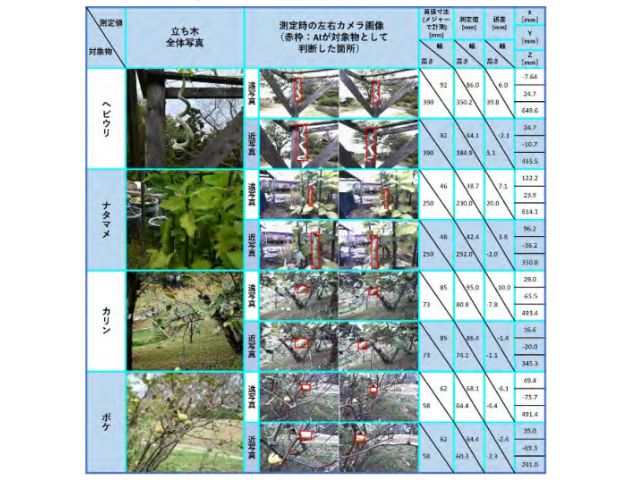

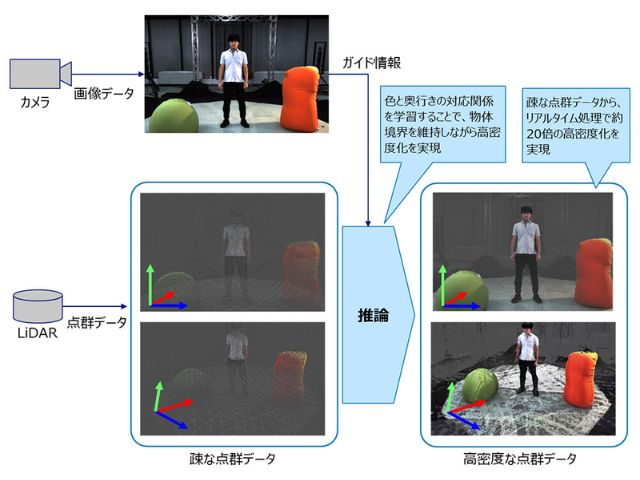

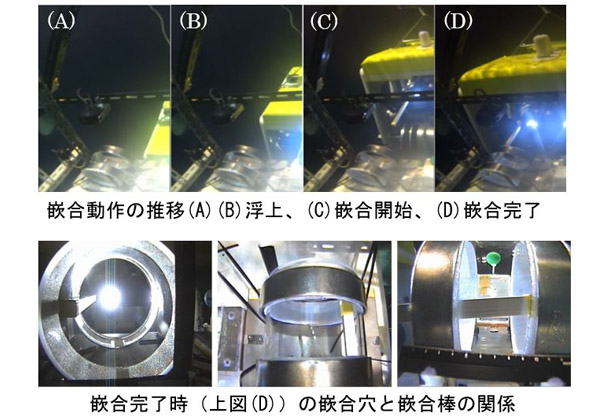

研究グループは,実時間複眼3次元立体認識3D-MoSを搭載したAUV「ツナサンド2」を用い,実験水槽(水深8m)での嵌合実験を実施。3D-MoSを用いてAUVに取り付けた嵌合棒を水中に設置した円筒形嵌合穴に嵌合させる充電模擬実験に成功した。

AUVを複眼カメラによる空間立体認識によって嵌合穴にドッキングさせる試みは世界初で,3D-MoSを用いたビジュアルサーボ技術(動画像を用いた画像認識によってロボットの運動制御を行なう技術)の有効性を実証した。

従来の画像認識に基づく自動嵌合技術は単眼カメラを用いた制御技術が主流であり,多くの動物が行なっている複眼空間認識方法とは異なっている。単眼であることからその実時間空間認識性能には改良の余地があった。複眼構成の3D-MoSは空間認識が容易であり,今回の実験で複眼カメラ自動制御技術の実用可能性を確認することができたとしている。

開発した複眼構成の3D-MoSは,①複眼動画像に対する実時間認識が可能であり,②水中対象物の3次元位置・姿勢自動空間認識が可能,③長時間潜航/作業を継続できる自律制御型水中ロボットに必要な技術,④動画像認識が可能なため移動対象物の追尾制御可能,という特徴を持つ。

今回の実験の意義は,複眼構成3D-MoSの自動嵌合性能をAUVで実証した点にある。この技術は海底で働く自律型水中ロボットの自動制御技術につながるものだとしている。