東京大学,NTTドコモ(ドコモ)の研究グループは,東京大学が開発したカメラ映像だけからモーションキャプチャーを行なう技術「VMocap」を応用することで,特殊な装置やスーツを用いずに,広い空間における複数人のモーションキャプチャーを行なう技術を開発した(ニュースリリース)。

東京大学,NTTドコモ(ドコモ)の研究グループは,東京大学が開発したカメラ映像だけからモーションキャプチャーを行なう技術「VMocap」を応用することで,特殊な装置やスーツを用いずに,広い空間における複数人のモーションキャプチャーを行なう技術を開発した(ニュースリリース)。

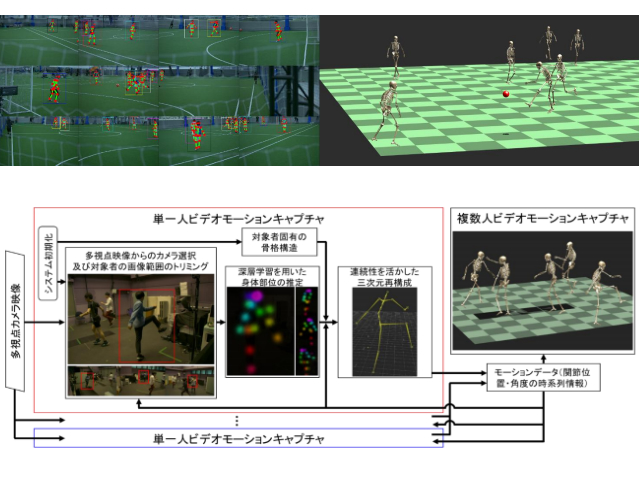

「VMocap」は深層学習によってカメラ映像における人の身体部位を推定する技術を,複数台のカメラから用いることで,3次元空間における身体部位の位置を推測し,その位置に対して骨格構造と運動の連続性に基づくフィルタ処理を施すことで,カメラ映像のみから高精度で滑らかなモーションキャプチャーを行なうもの。

一般的にモーションキャプチャーを行なうためには特殊な装置やスーツが必要で,計測場所や利用シーンが限定されている。近年では画像認識技術を応用することで特殊な機材を用いずに,カメラ映像だけからモーションキャプチャーを行なう技術も登場している。

しかし,映像上における人同士の重なり合いによる解析の難しさや,背景が切り抜き易い環境でしか用いることができないといった制約が原因で,屋内・屋外,空間の広さを問わずに複数人の高精度なモーションキャプチャーを行なう技術は実現されていなかった。

この技術は解析に用いるべき最適な映像を,複数のカメラから自動的に選択して切り替えることで,広い空間における複数人のモーションキャプチャーを行なう。

また,人同士の身体が映像上で重なって見える状況下でも,人の骨格構造と運動の連続性,そして最新の画像認識技術を活用することによって頑強に運動を推定することができ,フットサルのように複数の選手が激しく動き回るようなシーンでも,高精度で滑らかなモーションデータや骨の動きが取得出来ることを実証した。

またこの技術に加え,東京大学がもつロボティクスに基づいた動作解析技術を用いることで,骨の運動だけでなく身体に働く力や筋の活動まで計算し,可視化できることを確認した。これによって複数台のカメラ映像だけから,運動の計測・解析までが一貫して行なえるようになった。

今後はこの技術を,サッカー・野球・体操・フィギュアスケートなどのスポーツに適用し,トレーニングや戦術解析,障がい予防,運動のアーカイブ化などに役立てていくという。また,エンターテインメント領域における3Dアニメーション作成,介護・リハビリ現場での運動評価などにも活用していく予定としている。

なお,2020年1月23日(木)~1月24日(金)に東京ビッグサイトで開催する「DOCOMO Open House2020」にてこの技術に関するデモ展示を行なう。