NECと東京工業大学の研究グループは,一般カメラで撮影した可視光画像と,熱をとらえるサーモカメラなどで撮影した非可視光画像を,AIを用いて自動的かつ効果的に合成し,それぞれの画像単独では捉えにくかった対象物・状況の視認性を格段に高める「マルチモーダル画像融合技術」を共同開発した(ニュースリリース)。

NECと東京工業大学の研究グループは,一般カメラで撮影した可視光画像と,熱をとらえるサーモカメラなどで撮影した非可視光画像を,AIを用いて自動的かつ効果的に合成し,それぞれの画像単独では捉えにくかった対象物・状況の視認性を格段に高める「マルチモーダル画像融合技術」を共同開発した(ニュースリリース)。

近年,熱を捉えるサーモカメラや物体の内部を捉えるX線・テラヘルツ波・ミリ波のカメラなどの非可視光カメラを活用し,夜間や濃霧などの悪天候,または逆光や遮蔽などの悪条件下でも,監視や診断を行なう用途が広まりつつある。

しかし,これら非可視光カメラは,可視光に比べ解像度や画質が低く,視認性が悪いため,可視光カメラを併設し,両方の画像を見比べながら監視や診断を行なう必要があり,素早く正確に対象物や状況を判断することが困難だった。

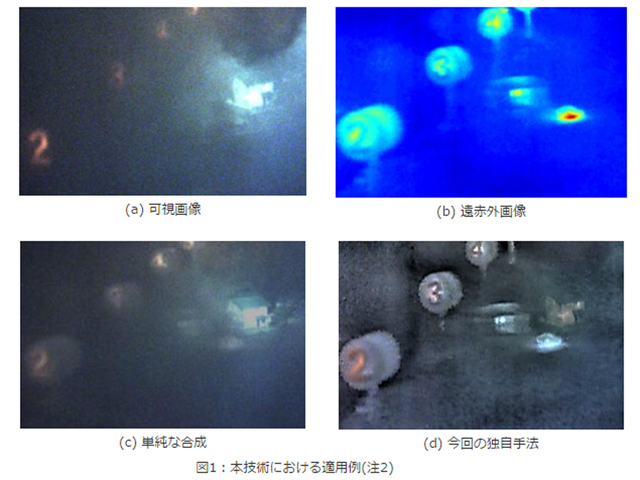

この解決には,二種類の画像を一つに合成することが有効な手段のひとつだが,従来は,それぞれの画像から合成に適した場所を抽出し,白とびや黒潰れ,ノイズ強調などの画像破たんが生じないように注意を払いながら,複雑な画像合成作業を行なう必要があった。

さらに,非可視光画像に含まれる,異常や危険物の有無を判断する手がかりとなるわずかな特徴が,合成により失われる点も課題だった。

この技術は,それぞれのカメラから得られた画像をAIによって,効果的かつ自動的に合成することでこの手作業を不要にした。さらに,可視光画像と非可視光画像のそれぞれの長所を積極的に活用することで,従来は視覚化が困難だったシーンでも高い視認性が得られる。

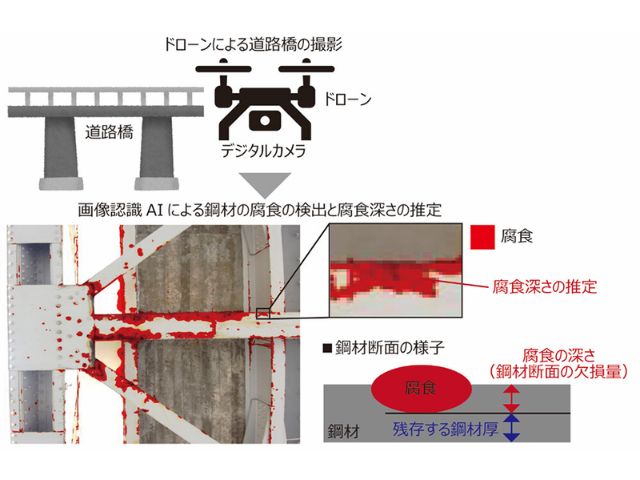

この技術により,瞬時の視認が必要となる様々な分野で,悪条件下でも正しい状況判断が可能になる。例えば,夜間や濃霧などの悪天候下でも活用可能な施設監視,対向車の眩しいヘッドライトや暗闇による死角があっても運用できる自動運転支援,建物のひび割れなど表面だけでなく内部の異常まで検査可能にするインフラ点検などがあるという。